Résultats du sondage – l’usage de l’IA au sein des OSBL – France générosités 2025

Publié le 13.02.2025

Découvrez les résultats du sondage sur l'utilisation de l'Intelligence artificielle au sein de 102 organisations membres de France générosités, entre état des lieux des opportunités perçues, niveau d'avancement des organisations, freins, usages individuels ou collectifs, outils, risques et éthique.

France générosités a lancé un sondage auprès de ses organisations membres sur l’utilisation de l’Intelligence artificielle (période de réponse : décembre 2024 à janvier 2025). 228 collaborateurs au sein de 102 structures d’intérêt général membres de France générosités ont répondu au sondage. Les répondants sont à la fois des utilisateurs et des non-utilisateurs d’outils d’IA ; ils représentent l’ensemble des services support (com, marketing, juridique, libéralités direction, administration…). L’objectif de ce sondage est d’aborder 3 grands sujets :

- Vision macro : état des lieux des opportunités perçues, niveau d’avancement et freins

- L’usage de l’IA au sein de votre organisation : usage, objectifs, outils

- Le contrôle et l’éthique : contrôle, risques, charte/politique, parties prenantes, utilités

Pour télécharger l’ensemble des résultats du sondage France générosités 2025 sur l’IA, cliquez ici.

1. L’usage de l’IA au sein des OSBL est-elle une démarche individuelle ou collective ?

91 % des répondants affirment que l’intelligence artificielle peut être un outil utile dans le cadre de leur travail et 99 % estiment que l’IA est une opportunité pour le secteur de la générosité. Les opportunités identifiées sont multiples (gain de productivité général permettant d’optimiser l’impact de la mission sociale, opportunité marketing…). Quelle que soit la typologie d’intelligence artificielle concernée (IA générative, IA prédictive…), les répondants ont bien conscience des limites et de l’encadrement nécessaire à l’usage de l’IA au sein des OSBL.

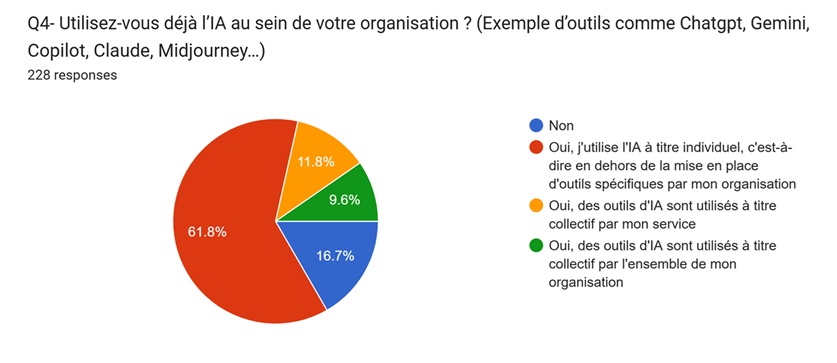

83 % des salariés répondants utilisent l’IA au sein de leur organisation mais seulement 22 % à titre collectif (au sein du service à 12 % et au sein de l’ensemble de l’organisation à 10 %). Un écart important qui sous entend aussi un phénomène de “shadow IA”, soit une utilisation plus ou moins cachée par les collaborateurs au sein de leur organisation.

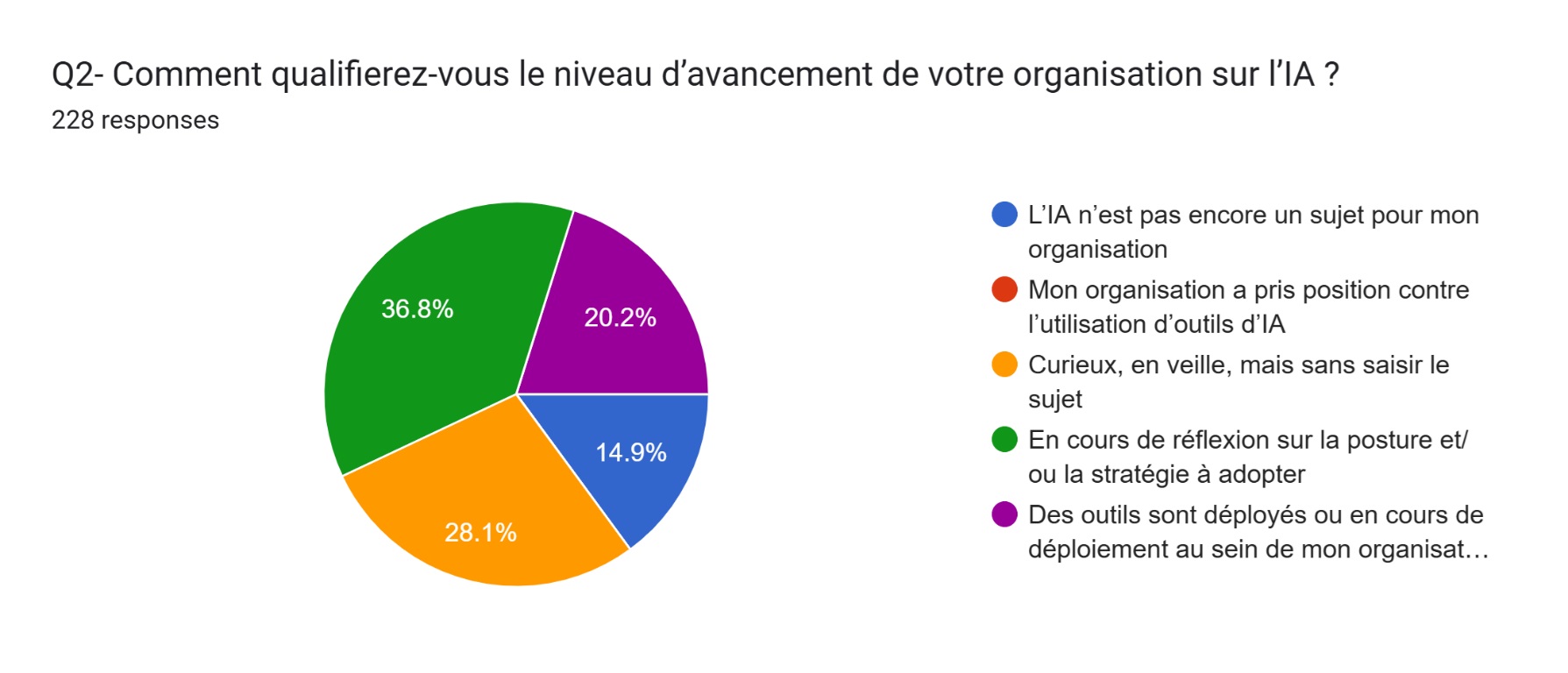

Il est donc important de regarder quel est le niveau d’avancement des différentes organisations sur l’IA. Selon les répondants au sondage, 57 % de leurs organisations auraient une attitude proactive sur l’IA, soit par une réflexion en cours sur la posture et la stratégie à adopter (37%), soit par la mise en place d’outils qui sont déjà déployés ou en cours de déploiement (20%).

L’existence de freins internes peut expliquer certaines des réticences à l’adoption de l’IA ou à une attitude proactive sur ce sujet. Sur cette question, voici les réponses les plus plébiscitées au sein du sondage :

- Difficulté à comprendre ou à implémenter les outils d’IA (manque de compétences en interne pour se saisir du sujet) : 56 %

- Le manque d’acculturation de la gouvernance (défiance ou manque de sensibilisation au sujet) : 33 %

- Difficulté à trouver un outil répondant aux normes éthiques de mon organisation : 25 %

- Manque de ressources financières / RH : 24 %

- La crainte des salariés d’être confrontés à des suppressions de postes : 11 %

- Désaccord entre services (marketing, juridique, DSI…) : 4 %

Un point important à souligner : nous n’avons pas observé de différences de freins selon les tailles des structures répondantes.

2. Quels sont les usages de l’IA par les collaborateurs des organisations membres de France générosités ?

Pour les répondants utilisant l’IA à titre individuel ou collectif au sein de leur organisation :

Le sondage France générosités s’est intéressé à dresser un état des lieux plus précis de l’usage de l’IA au sein des collaborateurs des organisations membres. A la question “dans le cadre de vos missions, comment utilisez-vous l’IA ?” voici les réponses sélectionnées :

- Travail de rédaction : rapport, newsletter, articles, outils de traduction… : 82 %

- Veille et recherches d’informations : 48 %

- Outils de communication : créer du contenu et générer de nouvelles idées (contenu personnalisé, réseaux sociaux, visuels…) : 44 %

- Elaboration d’une stratégie de collecte (analyse des données, analyse des comportements donateurs, identification de cibles stratégiques…) : 10 %

Nous voyons ici une grande majorité d’usage autour des IA génératives et très peu autour des IA prédictives. De surcroit, l’usage de l’IA pour l’élaboration de stratégies de collecte n’est pas encore répandu au sein des OSBL. Il est intéressant de noter que pour le panel plus restreint de répondants n’utilisant pas l’IA au sein de leur organisation, 66 % ont répondu que l’IA pourrait cependant être utile pour l’élaboration de leur stratégie de collecte.

Cette tendance est confirmée par les outils les plus plébiscités par ces mêmes collaborateurs utilisateurs de l’IA, qui sont majoritairement des outils IA générative et parmi les plus connus / médiatisés, comme vous pouvez le voir ici :

- Chatgpt : 84 %

- Microsoft copilot : 26 %

- Gemini : 10 %

- Mistral : 4 %

- Midjourney : 4 %

- Adobe Firefly : 3%

- Claude : 5 répondants

- Perpexity : 7 répondants

- + 1 ou 2 répondants / item : Fireflies, Napkin, RunWay, deepl, Ally, CRF, Python, canva

Nous observons cependant que quelques répondants ont des profils plus connaisseurs sur lesquels pourraient s’appuyer les réflexions internes liées à l’IA au sein de vos organisations. Il convient à ce titre de faire remonter la connaissance au sein des différents services et de solliciter les collaborateurs idoines pour élaborer une stratégie globale intéressante et différenciante.

Enfin, s’agissant de la fréquence d’utilisation, 61 % des répondants utilisent ces outils d’IA de 1 fois par semaine à tous les jours.

3. Quels risques et quelles bonnes pratiques associées pour l’usage de l’IA au sein de vos organisations ?

Tout d’abord, il convient de noter que 85 % des répondants au sondage exercent un contrôle systématique sur les résultats produits par l’IA, relecture et vérification des informations notamment. Une prudence qui n’est pas systématique mais occasionnelle pour 12 % des répondants et jamais présente pour 3 %.

Ensuite, une majorité des répondants (117 sur 207 à cette question) affirment qu’il y a des risques éthiques à l’usage de l’IA au sein de leur organisation. Pour une partie (25 sur 207), ces risques n’existent pas. Et un peu plus d’un quart des répondants n’arrivent pas forcément à se positionner sur cette problématique.

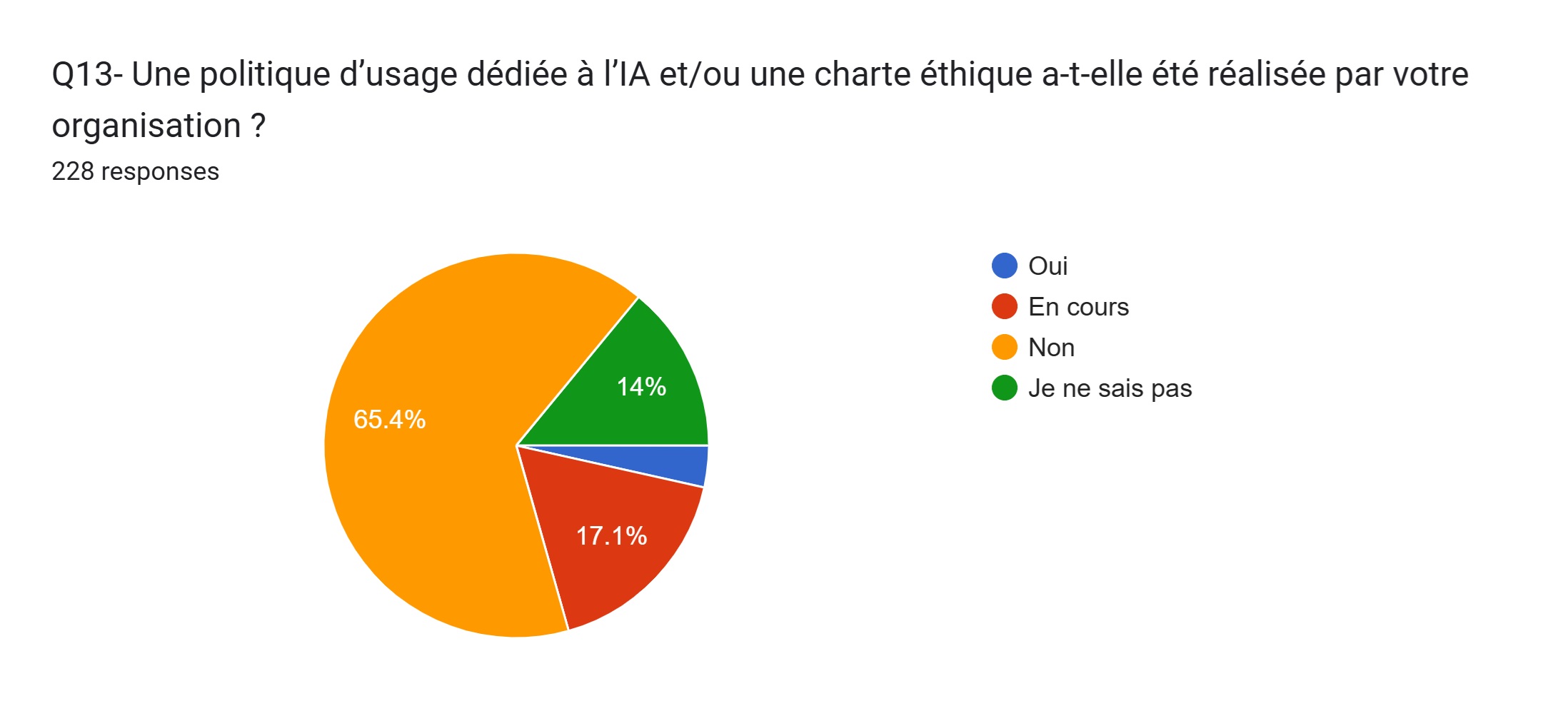

Pour y répondre, 5 organisations auraient mis en place une charte éthique ou une politique d’usage dédiée à l’IA. 17% des répondants indiquent qu’une démarche similaire est en cours au sein de leur structure. Cependant, 65 % affirment qu’il n’existe aucune charte éthique/politique d’usage de l’IA au sein de leur organisation ou de démarches en cours.

Pour les 21 % qui connaissent l’existence ou le travail en cours d’une charte éthique / politique d’usage dédiée à l’IA en interne à leur organisation, seulement 17 % des répondants indiquent qu’une démarche collective a été adoptée pour la construire, comme vous pouvez le voir avec les réponses sur les parties prenantes mobilisées :

- Quelques services (DSI, juridique) : 75 %

- Gouvernance (CA…) : 49 %

- L’ensemble des salariés : 17 %

- Agence /prestataire : 4 %

- Bénévole : 2 % (soit 1 organisation)

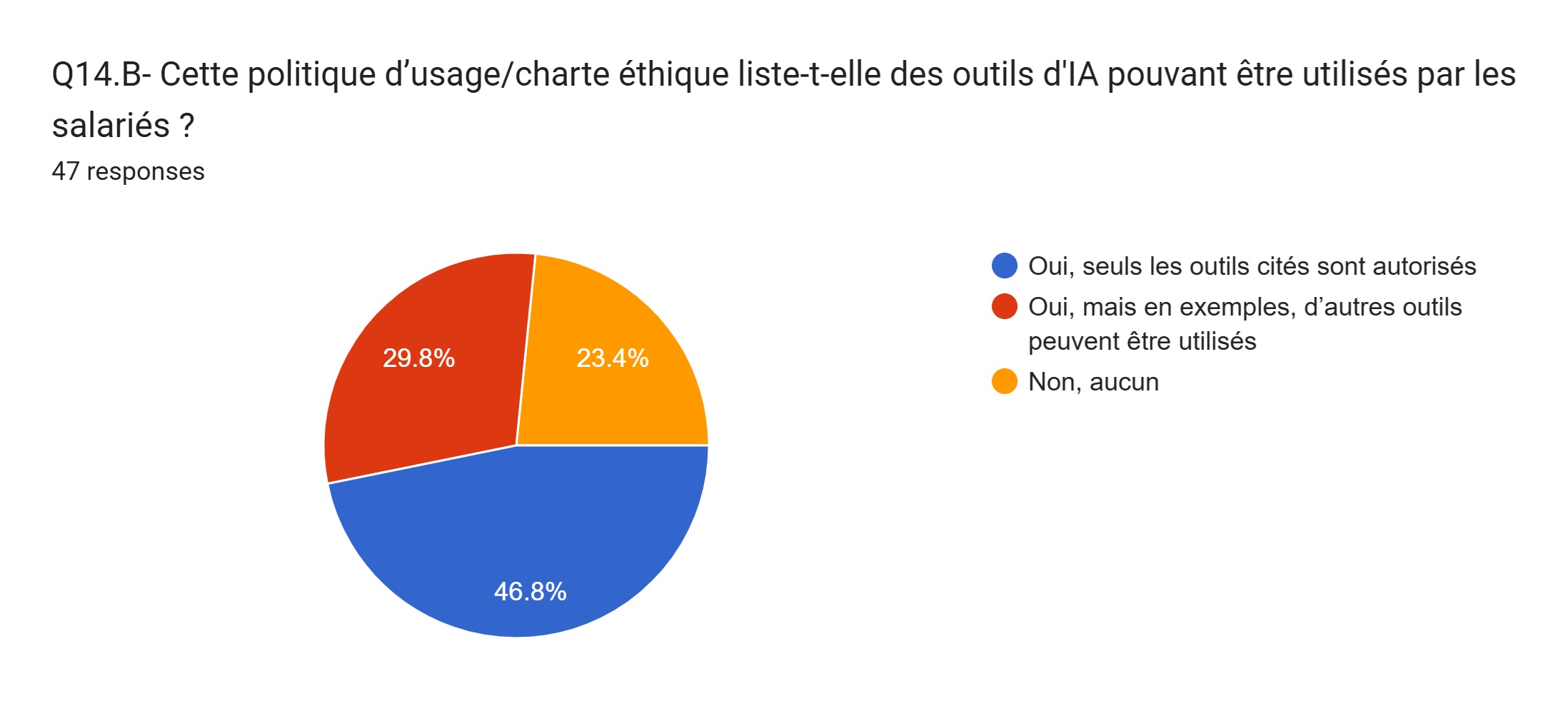

Certaines des organisations ont choisi de lister de manière limitative les outils autorisés dans leur politique dédiée à l’IA. D’autres ont simplement décidé d’encadrer l’usage de l’IA sans limiter son usage à un ou plusieurs outils. Le cas échéant, des exemples sont cités dans les politiques d’usage ou chartes éthique.

Cela étant, cette vision est partagée par un grand nombre de collaborateurs puisque nous pouvons observer que les conditions plébiscitées pour que l’usage de l’IA au sein des organisations soit conforme à leurs valeurs sont :

- Que l’utilisation de l’IA soit toujours complétée d’un regard humain : 88 %

- Que votre organisation autorise uniquement l’usage d’outils qui répondent à un certain nombre de critères préétablis (protection des données, pas de transfert de données à des fins d’entrainement de l’IA, minimisation de l’impact environnemental, entreprise française ou européenne…) : 84 %

- Que l’utilisation de ces outils soit transparente (en interne et en externe) : 60 %

- Que l’utilisation de ces outils puisse être contrôlée en interne : 49 %

- Que le choix d’utilisation de l’IA ait été réalisé avec l’ensemble des parties prenantes (ou une grande partie) : 41 %

- Que les donateurs puissent demander à ce qu’il n’y ait pas d’utilisation d’IA au sein de leur relation avec votre organisation : 23 %

Charte éthique = opportunité pour renforcer le lien avec ses donateurs ?

Enfin, la question qui nous paraissait intéressante à poser aux collaborateurs des organisations membres de France générosités concerne les opportunités et utilités perçues par les collaborateurs de cette charte éthique de l’IA :

- Contrôle l’usage de l’IA au sein de son organisation : 77 %

- La mise en place d’outils pertinents pour vos expertises métiers : 66 %

- Garantir la transparence et établir une relation de confiance avec vos donateurs 47 %

Nous continuons d’aborder au sein de France générosités les opportunités marketing et de collecte de fonds associés à l’usage de l’Intelligence artificielle au sein de vos organisations et y compris par une normalisation ou l’établissement d’un cadre de transparence et de confiance co-construit avec l’ensemble de ses parties prenantes.

< Pour télécharger l’ensemble des résultats du sondage France générosités 2025 sur l’IA, cliquez ici. >

|

Article écrit par : Corentin Hue Responsable digital et développement chue@francegenerosites.org |